Neovulga – Veille Vulgarisée – Concept Whitening

Neovulga – Veille Vulgarisée – Concept Whitening

A Neovision, nous menons une veille scientifique constante pour rester à l’état de l’art. Chaque mois, les dernières avancées sont présentées à l’ensemble de l’équipe, que ce soit de nouveaux jeux de données, un nouveau papier de recherche… Nous passons toutes les actualités – ou presque – au crible. Dans notre ambition visant à mettre l’IA à la portée de tous, nous vous proposons, chaque mois, l’analyse vulgarisée d’un sujet technique présenté par notre cellule R&D.

Ici, nous traiterons de l’article scientifique Concept Whitening For Interpretable Image Recognition, par Zhi Chen, Yijie Bei, Cynthia Rudin.

Contexte

Les calculs effectués par les réseaux de neurones sont souvent opaques et les décisions qui en résultent difficiles à comprendre. Plusieurs techniques ont été mises en place afin de tenter d’améliorer leur explicabilité, mais ces dernières restent toujours limitées en termes d’interprétation.

En effet, il n’est pas toujours aisé de comprendre les résultats des différentes couches du réseau. Et lorsque l’on met le doigt sur les différents concepts présents, ceux-ci ne sont potentiellement pas compréhensibles par un humain.

C’est dans ce contexte qu’est né le Concept Whitening, un module qui, inséré dès l’entraînement, augmente fortement la puissance explicative du réseau.

L’avancée présentée

Le Concept Whitening est un module qui se branche après une couche du réseau. A chaque sortie de couche, le réseau produit une représentation abstraite, aussi appelée espace latent, qui nous est difficilement compréhensible. Le Concept Whitening vient forcer la représentation à avoir du sens, en l’alignant sur des concepts interprétables.

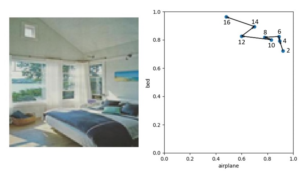

Si la représentation s’aligne correctement sur les concepts, alors le module est récompensé. Par exemple, lorsque l’on souhaite reconnaître une chambre, on va souhaiter que tout ce qui se trouve dans l’espace latent corresponde à une chambre.

Sur l’image ci-dessus, on a inséré le Concept Whitening après plusieurs couches afin de regarder avec quel concept l’image vient s’aligner. On remarque que sur les premières couches, le réseau reconnaît plus un avion qu’un lit. Pour cause, il se réfère surtout aux couleurs, et une masse blanche sur un fond bleu va plus se rapporter à un avion.

Pourquoi c’est cool ?

L’édito d’Arthur

« L’explicabilité des réseaux de neurones est un sujet majeur, notamment avec des réseaux aussi conséquents que ceux utilisés en deep learning. Or, de nombreuses méthodes se concentrent sur l’explication a posteriori de leur fonctionnement : c’est-à-dire que le réseau est déjà entraîné et qu’on essaye d’aller regarder ce qu’il se passe à l’intérieur.

Le Concept Whitening fait partie d’une catégorie de méthodes dans lesquelles l’explicabilité est un choix de conception. On ajoute en effet un module permettant d’améliorer la compréhension du réseau au moment de l’entraînement, ce qui donne à ces méthodes un potentiel explicatif bien plus important. De plus, le Concept Whitening a l’avantage d’être très simple à intégrer et entraîner, remplaçant sans perte de performances un module de Batch Normalization.«

Le module s’inscrit dans un mouvement global d’amélioration de l’explicabilité des réseaux de neurones. En effet, il est important de casser l’aspect boîte noire des réseaux de neurones. Ceci permet à la fois de mieux comprendre comment ils fonctionnent et donc les améliorer et d’aider à l’acceptation de l’intelligence artificielle par la population.

Relativement simple à implémenter, il peut remplacer des modules de Batch Normalization, quasi systématiquement intégrés aux réseaux et qui permettent d’améliorer les performances de ces derniers. De plus, le Concept Whitening a la particularité d’être inséré au moment de l’entraînement, ce qui rend sa puissance explicative bien plus forte que des analyses a posteriori.

Pingback: Acceptabilité de l'Intelligence Artificielle : un vaste chantier